RTC SDK提供了获取音频数据的功能,您可以将获取到的语音数据根据实际需求进行处理。通过阅读本文,您可以了解到获取音频数据的方法。

使用场景

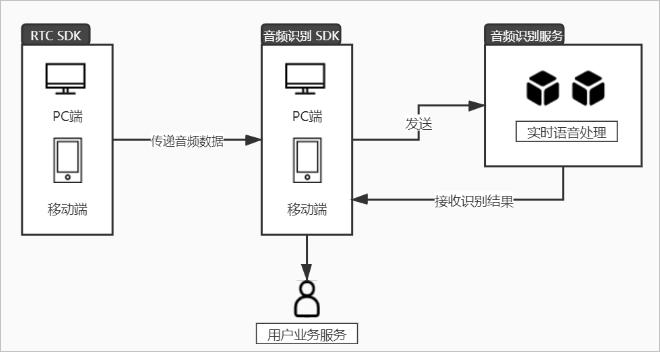

您可以将本地发布端或订阅端的音频数据通过阿里云语音识别服务转换成文字,实现流程如下所示:

- 阿里云RTC会将音频数据发送至音频识别SDK中。

- 音频识别SDK将音频数据发送至音频识别服务进行实时语音处理并返回识别结果。

- 音频识别SDK为用户提供识别结果。

方案架构图

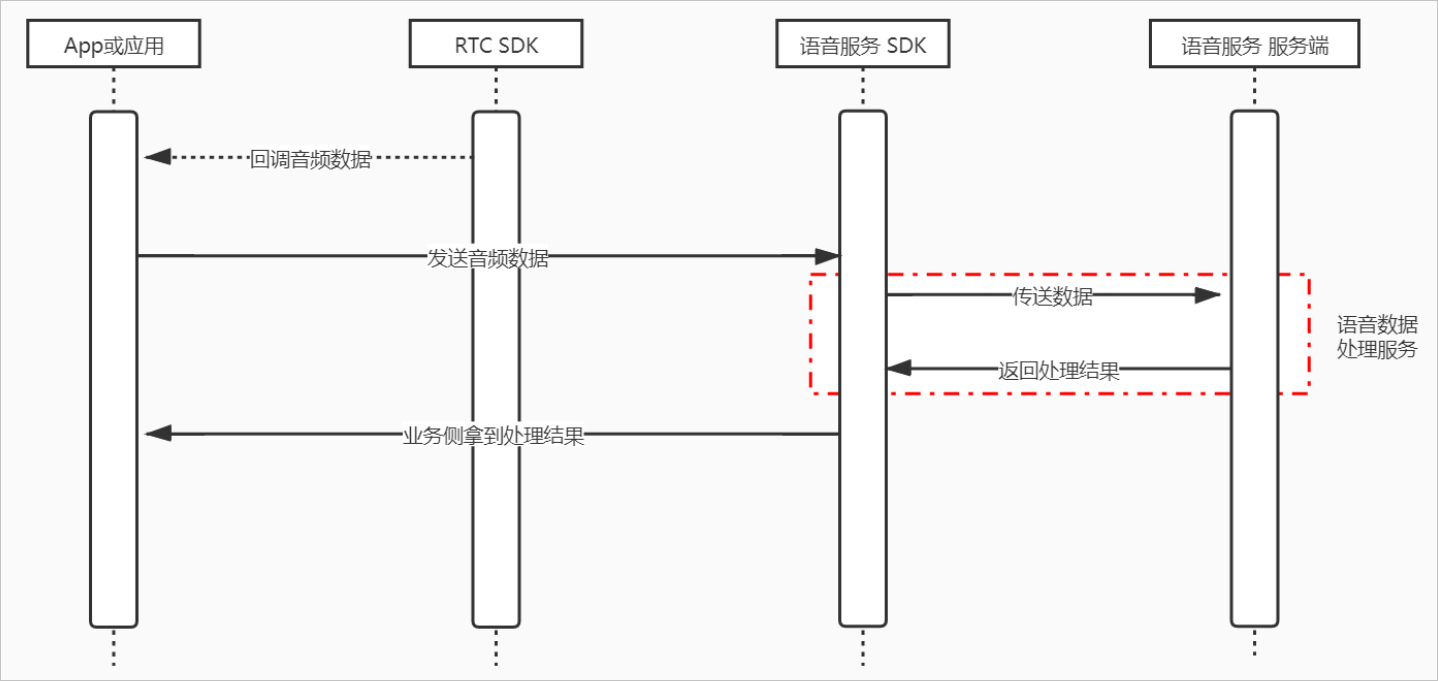

调用时序图

接口及使用

通过调用接口subscribeAudioData得到回调数据,从回调接口onAudioSampleCallback获取音频数据,并根据业务场景使用相应的数据源。

onAudioSampleCallback接口参数如下:

| 参数 | 类型 | 描述 |

|---|---|---|

| audioSource | AliRtcAudioSource | 音频裸数据源类型。 |

| audioSample | AliRtcAudioDataSample * | 音频裸数据。 |

语音数据处理

RTC获取音频数据方式如下: