Llama2-7B-Chat大模型的轻量化LoRA微调及量化

learn

手动配置

80

教程简介

在本教程中,您将学习如何在阿里云交互式建模(PAI-DSW)中,使用单卡对Llama2-7B-Chat大模型进行轻量化LoRA微调及量化。

Llama 2是Meta开发并公开发布的系列大型语言模型(LLMs),它是系列预训练和微调的生成文本模型,规模从70亿到700亿参数不等。本次使用的模型是Llama2-7B-Chat,专为对话用例进行优化。Meta声明,在他们测试的大多数基准中,Llama-2-Chat模型的表现优于开源聊天模型,并且在Meta对帮助性和安全性的人类评估中,与一些流行的闭源模型如ChatGPT和PaLM相当。

使用此模型受Meta许可证的约束。在使用模型前,请确认已经前往自定义可商用开源协议网站完成申请。

我能学到什么

学会如何快速在阿里云上创建一个交互式训练开发环境。

学会如何在DSW中进行Llama2模型LoRA微调。

学会如何在DSW中进行Llama2模型量化。

操作难度 | 中 |

所需时间 | 80分钟 |

使用的阿里云产品 |

|

所需费用 | 0元 |

准备环境和资源

5

开始教程前,请按以下步骤准备环境和资源:

【重要】:PAI-DSW免费资源包只适用于本教程中的PAI-DSW产品。如果您领取了PAI-DSW资源包后,使用了PAI-DSW及PAI的其他产品功能(如PAI-DLC、PAI-EAS等),PAI-DSW产品产生的费用由资源包抵扣,其他产品功能产生的费用无法抵扣,会产生对应的费用账单。

访问阿里云免费试用。单击页面右上方的登录/注册按钮,并根据页面提示完成账号登录(已有阿里云账号)、账号注册(尚无阿里云账号)或实名认证(根据试用产品要求完成个人实名认证或企业实名认证)。

成功登录后,在产品类别下选择,在交互式建模PAI-DSW卡片上单击立即试用。

【说明】:如果您此前已申请过试用PAI的免费资源包,此时界面会提示为已试用,您可以直接单击已试用按钮,进入PAI的控制台。

在交互式建模PAI-DSW面板,勾选服务协议后,单击立即试用,进入免费开通页面。

【重要】以下几种情况可能产生额外费用。

使用了除免费资源类型外的计费资源类型:

您申请试用的是PAI-DSW免费资源包,但您创建的DSW实例使用的资源类型非阿里云免费试用提供的资源类型。当前可申请免费使用的资源类型有:ecs.gn6v-c8g1.2xlarge、ecs.g6.xlarge、ecs.gn7i-c8g1.2xlarge。

申请试用的免费资源包与使用的产品资源不对应:

您创建了DSW实例,但您申请试用的是DLC或EAS产品的免费资源包。您使用DSW产品产生的费用无法使用免费资源包抵扣,会产生后付费账单。

您申请试用的是DSW免费资源包,但您使用的产品是DLC或EAS。使用DLC和EAS产品产生的费用无法使用DSW免费资源包抵扣,会产生后付费账单。

免费额度用尽或超出试用期:

领取免费资源包后,请在免费额度和有效试用期内使用。如果免费额度用尽或试用期结束后,继续使用计算资源,会产生后付费账单。

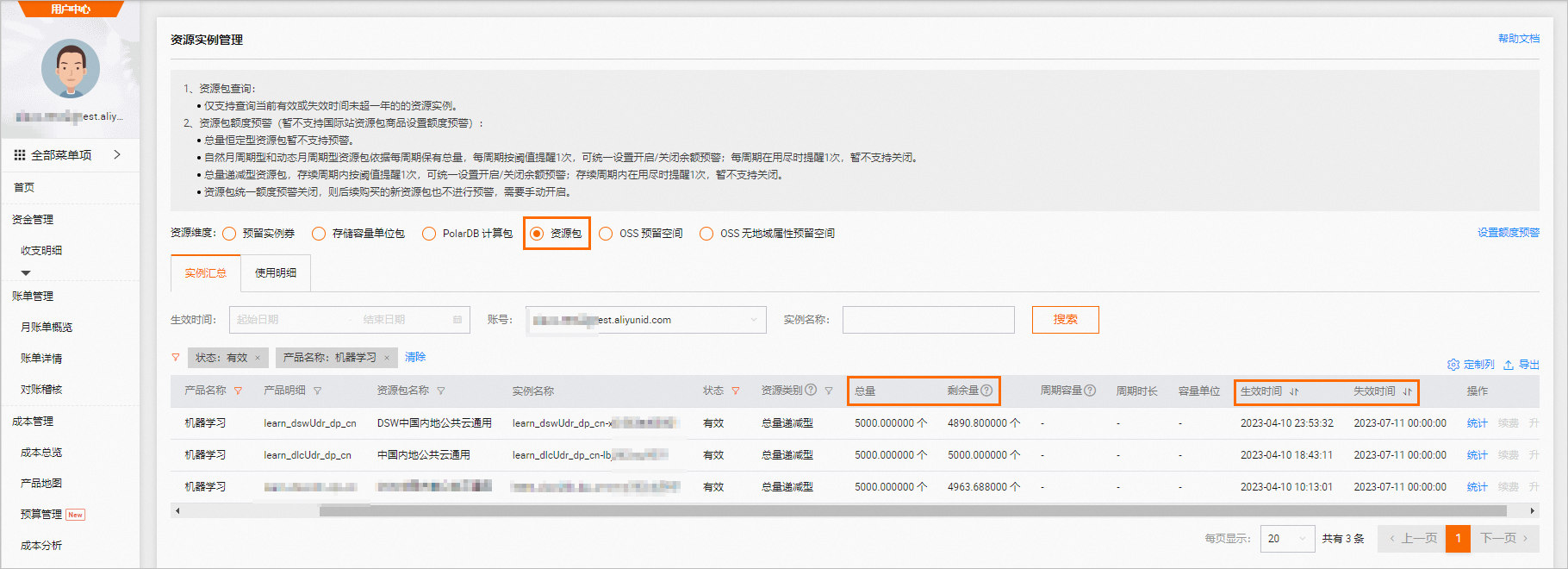

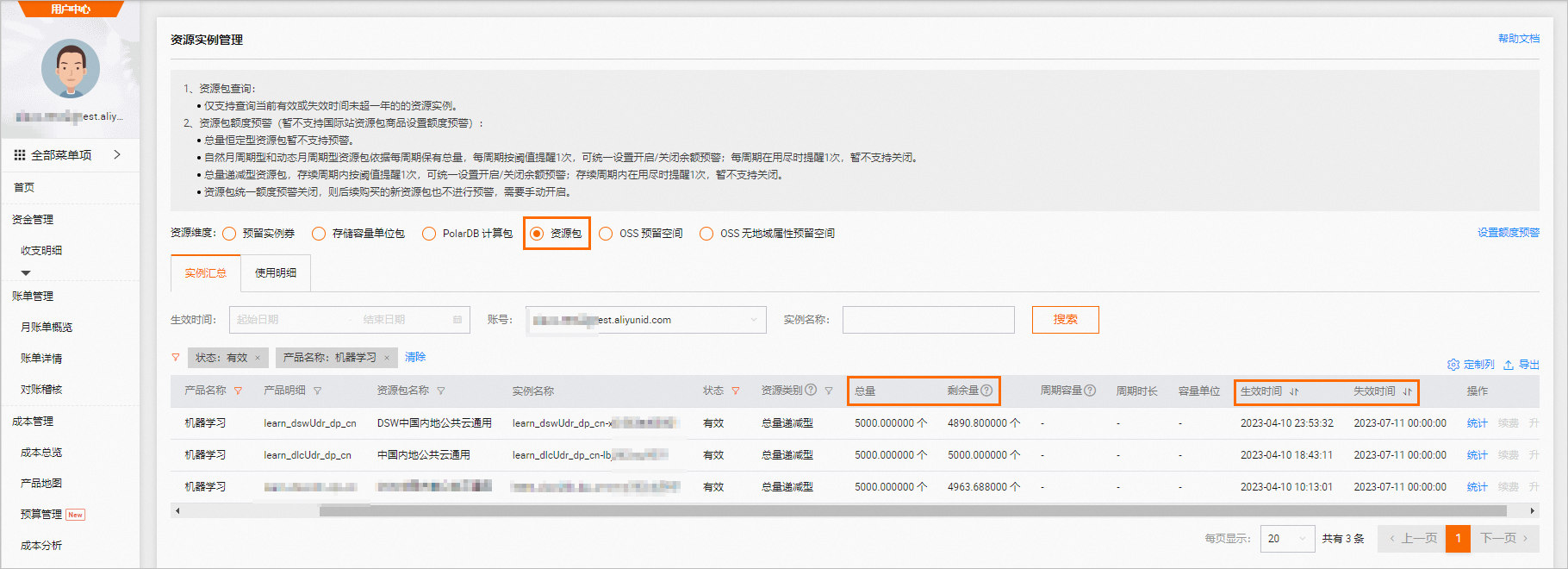

请前往资源实例管理页面,查看免费额度使用量和过期时间,如下图所示。

开通人工智能平台PAI并创建默认工作空间。其中关键参数配置如下,更多详细内容,请参见开通并创建默认工作空间。

本教程地域选择:华东1(杭州)。您也可以根据情况选择华北2(北京)、华东2(上海)、华南1(深圳)地域。

单击免费开通并创建默认工作空间:在弹出的开通页面中配置订单详情。配置要点如下。

本教程不需要开通其他产品,您需要在组合开通配置模块,去勾选其他产品的复选框。

在服务角色授权模块单击去授权,根据界面提示为PAI完成授权,然后返回开通页面,刷新页面,继续开通操作。

开通成功后单击进入PAI控制台,在默认工作空间中,,创建DSW实例。其中关键参数配置如下,其他参数取默认配置即可。更多详细内容,请参见创建DSW实例。

【说明】:创建DSW实例需要一定时间,与当前的资源数有关。如果您使用地域资源不足,可更换其他支持免费试用的地域申请开通试用并创建DSW实例。

参数

描述

地域及可用区

本教程选择:华东1(杭州)。

实例名称

您可以自定义实例名称,本教程示例为:Llama2_test_01。

资源配额

本教程需选择公共资源(后付费)的GPU规格,规格名称为ecs.gn6v-c8g1.2xlarge。

【说明】:阿里云免费试用提供的资源类型包括以下几种类型:

ecs.gn7i-c8g1.2xlarge

ecs.g6.xlarge

ecs.gn6v-c8g1.2xlarge

选择镜像

选择官方镜像中的pytorch-develop:1.12-gpu-py39-cu113-ubuntu20.04。

在DSW中打开教程文件

5

进入PAI-DSW开发环境。

登录PAI控制台。

在页面左上方,选择DSW实例所在的地域。

在左侧导航栏单击工作空间列表,在工作空间列表页面中单击默认工作空间名称,进入对应工作空间内。

在左侧导航栏,选择模型开发与训练>交互式建模(DSW)。

单击需要打开的实例操作列下的打开,进入PAI-DSW实例开发环境。

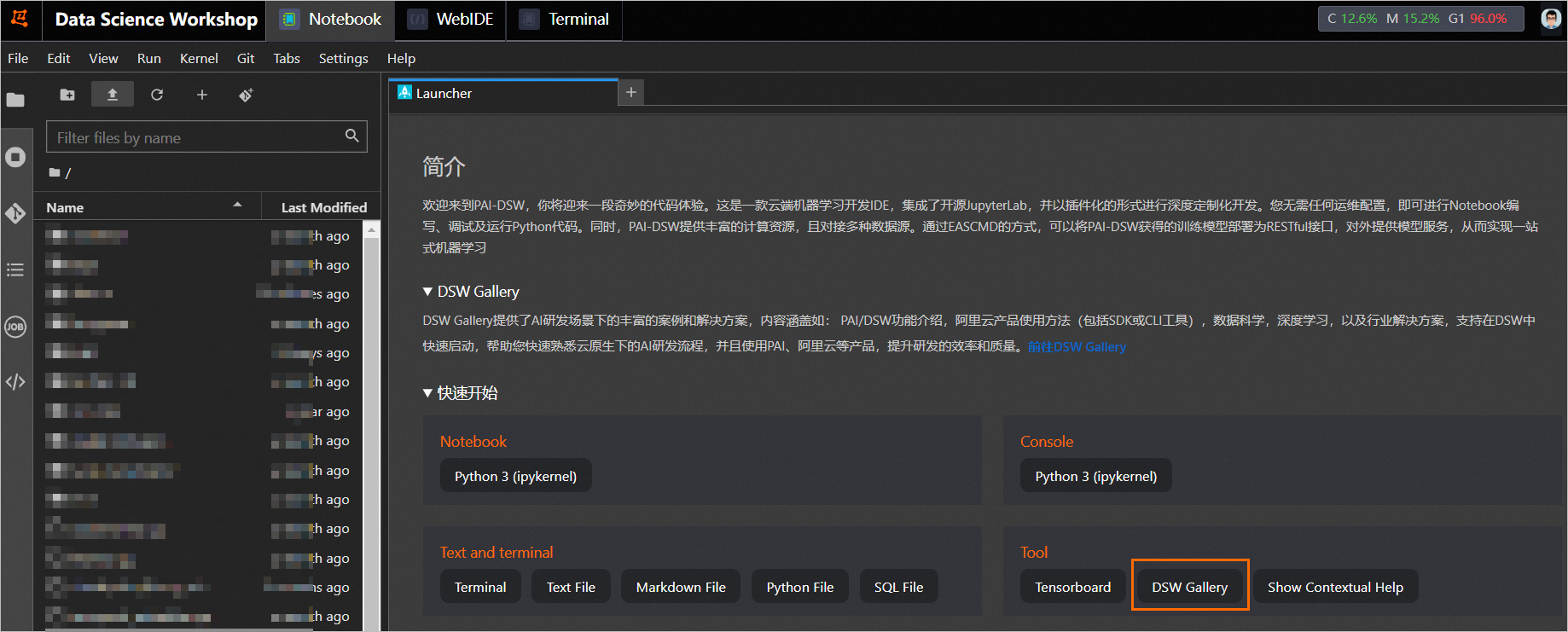

在Notebook页签的Launcher页面,单击快速开始区域Tool下的DSW Gallery,打开DSW Gallery页面。

在DSW Gallery页面中,搜索并找到Llama2-7B-Chat大模型的LoRA微调教程,单击教程卡片中的在DSW中打开。

单击后即会自动将本教程所需的资源和教程文件下载至DSW实例中,并在下载完成后自动打开教程文件。

运行教程文件

60

在打开的教程文件llama2_lora.ipynb文件中,您可以直接看到教程文本,您可以在教程文件中直接运行教程。本教程有以下几个步骤:

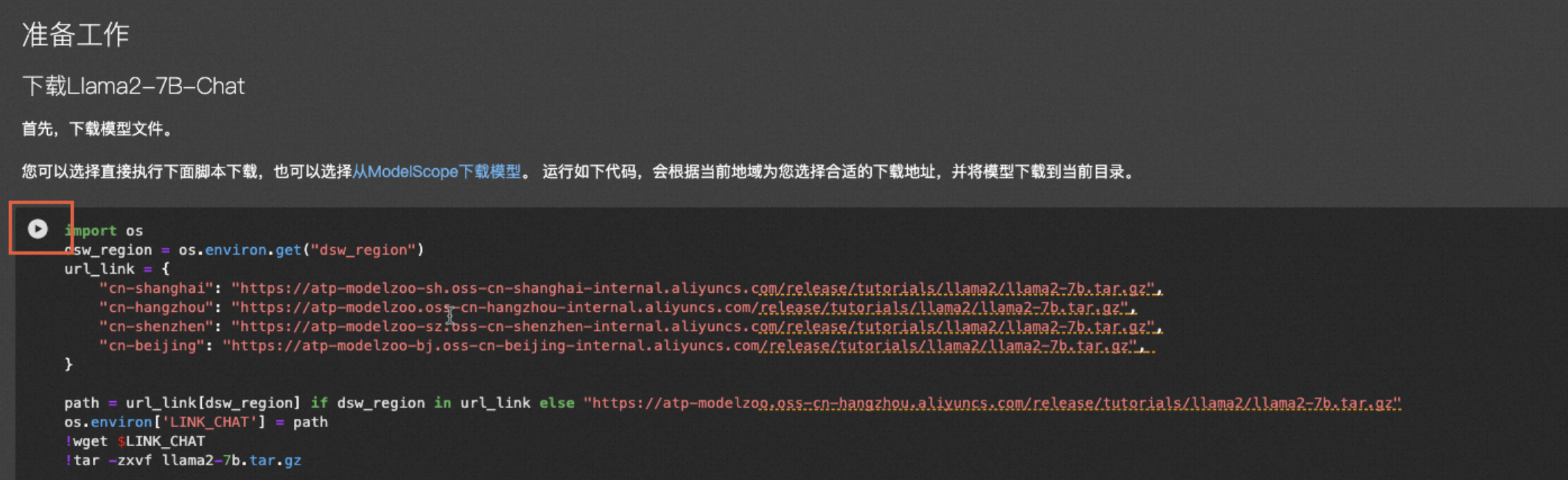

下载模型

下载和安装插件

【说明】模型以及插件下载会花费较多时间:Llama2模型、插件大小14G左右,实际下载时间受网速影响。

下载示例训练数据,您也可以参考数据格式自行准备所需数据。

LoRA微调模型及量化

试玩模型

在教程文件中直接运行对应的步骤的命令时,当成功运行结束一个步骤命令后,再顺次运行下个步骤的命令。

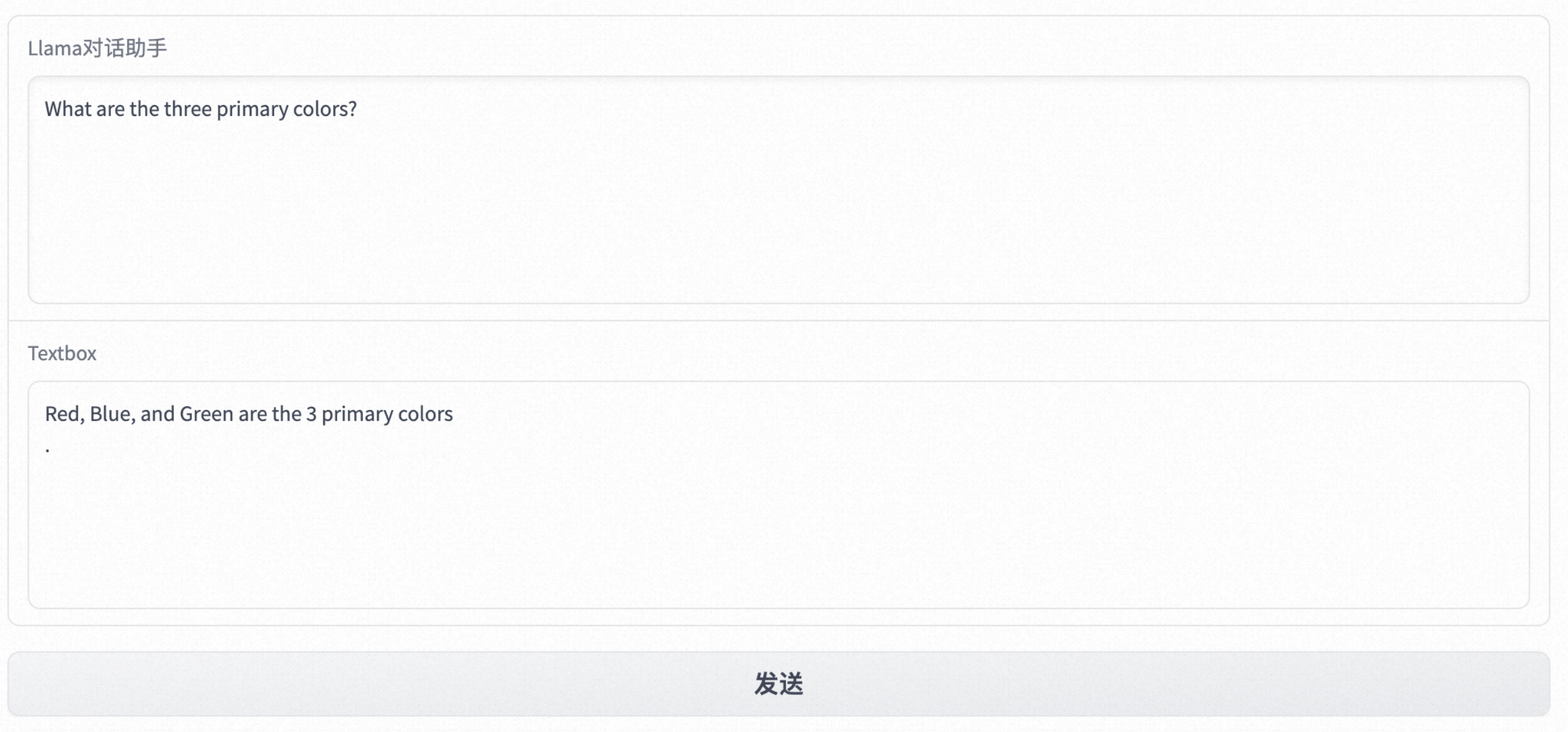

试玩模型步骤中,在返回的运行详情结果中单击URL链接,进入WebUI页面。后续您可以在该页面进行文字互动。

完成

5

完成以上操作后,您已经成功完成了Llama2-7B-Chat大模型的轻量化LoRA微调及量化。您可以在WebUI页面,进行对话。

清理及后续

5

清理

领取免费资源包后,请在免费额度和有效试用期内使用。如果免费额度用尽或试用期结束后,继续使用计算资源,会产生后付费账单。

请前往资源实例管理页面,查看免费额度使用量和过期时间,如下图所示。

如果无需继续使用DSW实例,您可以按照以下操作步骤停止DSW实例。

登录PAI控制台。

在页面左上方,选择DSW实例的地域。

在左侧导航栏单击工作空间列表,在工作空间列表页面中单击默认工作空间名称,进入对应工作空间内。

在工作空间页面的左侧导航栏选择模型开发与训练>交互式建模(DSW),进入交互式建模(DSW)页面。

单击目标实例操作列下的停止,成功停止后即停止资源消耗。

如果需要继续使用DSW实例,请务必至少在试用到期1小时前为您的阿里云账号充值,到期未续费的DSW实例会因欠费而被自动停止。

后续

在试用有效期期间,您还可以继续使用DSW实例进行模型训练和推理验证。

总结

常用知识点

问题1:本教程使用了DSW的哪个功能完成了模型的训练及推理?(单选题)

Notebook

Terminal

WebIDE

正确答案是Notebook。

问题2:本教程使用了哪种方法演示Llama2-7B-Chat大模型的微调?

Freeze方法

P-Tuning方法

LoRA方法

正确答案是LoRA方法。